Consideremos uma escolha aleatória de uma família com dois filhos. O espaço amostral é

e a probabilidade de cada evento elementar é . Qual é a probabilidade de ambos serem meninos sabendo-se que pelo menos um deles é menino? Dado que um menino, a resposta é um elemento de

, portanto a probabilidade de ambos serem meninos é

. Retomemos o modelo clássico para motivar a definição de probabilidade condicional. Se

e

são eventos de

e se ocorreu um dos

pontos amostrais de

, então

ocorre se um dos

pontos amostrais de

ocorre de modo que a probabilidade com que

ocorre se é sabido que

ocorre é

Num modelo probabilístico a probabilidade condicional do evento

com respeito ao evento

, em que

, é definida por

e é lido como a probabilidade de

dado

.

Proposição 11 (Teorema da Multiplicação) Se

e

são eventos de um modelo probabilístico com

então

Analogamente,

, quando

.

Exemplo 18 Dois dados, um azul e outro verde, são lançados e cada uma das seis faces são equiprováveis nos dois dados. Qual é a probabilidade do dado verde ter resultado 6 dado que a soma dos resultados foi 8? O espaço amostral tem

elementos equiprováveis, formado pelos pares ordenados dos resultados possíveis. Os eventos de interesse são

A probabilidade que procuramos é

Exemplo 19 Numa cômoda há três gavetas e em cada gaveta um par de meias. Na primeira gaveta há um par de meias brancas, na segunda um par de meias pretas e na terceira gaveta um par com um pé de meia de cada cor, preta e branca. Uma das três gavetas é escolhida ao acaso e em seguida, sem olhar para o interior da gaveta escolhida, essa gaveta é aberta e um pé de meia é escolhido aleatoriamente dentre os dois pés daquela gaveta; a gaveta escolhida é fechada. O pé de meia retirado é branco. Qual a probabilidade de o outro pé que ficou sozinho na gaveta ser preto?

Se

é o evento “retirou uma meia branca”, e

o evento “ficou uma meia preta”, então

e

, logo

Nesse exemplo podemos construir um modelo probabilístico considerando o espaço amostral formado pelos pares

, com as gavetas numeradas de um a três

com os eventos elementares da primeira linha 2 vezes mais prováveis (por quê?; reveja o exemplo Monty Hall) que os da segunda, de modo que cada um dos dois primeiros eventos elementares listados no espaço amostral têm probabilidade

e o outros dois probabilidade

cada. Os eventos são

e, só conferindo,

.

Exemplo 20 No problema do exercício 31 os eventos que interessam são

“a face exibida é laranja” e

“a face não-exibida é laranja”. Como metade das faces são laranjas,

. Só uma das cartas tem as duas faces laranjas logo

, assim a probabilidade que interessa é

Descreva detalhadamente o espaço amostral e os eventos desse experimento.

Exercicio 33 (Lewis Carrol) Leia a seguinte “prova” de que uma urna não pode ter duas bolas da mesma cor:

Uma urna contém um par de bolas que podem ser da cor brancaou preta

, de modo que

. Adicionamos uma bola preta de modo que

. Agora, sorteamos uma bola e a probabilidade que essa bola é preta é, usando probabilidade condicional

Se a probabilidade de sortear uma bola preta é

então o par original de bolas não pode ser

nem

, ou seja, não podem ter a mesma cor. Faça uma análise criteriosa dessa (falsa) dedução.

Exercicio 34 Seja

é uma medida de probabilidade para os eventos em

e

um evento com probabilidade positiva. Defina a função

por

Prove que

é uma medida de de probabilidade para os eventos em

(i.e, mostre que

satisfaz os axiomas de probabilidade a partir do fato de que

os satisfazem).

— Teorema da Probabilidade Total —

Observemos que se e

são eventos,

, então

ocorre se e só se

e

ocorre

ou

e

ocorre

e é uma partição de

, logo de

deduzimos

Tal fato é um caso particular do seguinte resultado.

Exemplo 21 (Monty Hall revisitado) Se o jogador não troca de porta, ele acerta o carro com probabilidade de acertar uma dentre três portas, i.e.,

. Se o jogador troca de porta, então consideremos os eventos

e

Então

,

e

. Pela lei da probabilidade total

portanto, é melhor trocar de porta.

Teorema da probabilidade total — caso geral. Seja uma partição de

por eventos com

para todo

. Para qualquer evento

Exemplo 22 Uma fábrica de sorvete compra galões de leite de 3 fazendas diferentes.

- A fazenda

entrega todo dia

do leite usado e uma inspeção revelou que

desse leite estava adulterado.

- A fazenda

entrega

do leite usado e a inspeção revelou que

estava adulterado.

- A fazenda

entrega

do leite usado,

adulterado.

Os galões são indistinguíveis. Um é escolhido ao acaso. Qual a probabilidade do evento

“ter leite adulterado”?

O espaço amostral

representa os galões de leite e pode ser particionado como

. A inspeções nos fornecem as probabilidades

usando o teorema da probabilidade total determinamos

Agora, dado que a amostra de leite está adulterada, qual é a probabilidade de ter sido escolhida da fazenda F1?

Suponha que probabilite é uma doença rara que afeta apenas da população, e que existe um teste para detectar probabilite e que não é perfeito: há

de falsos positivos e

de falsos negativos. Dado que o teste para um determinado paciente deu positivo, qual é a probabilidade que ele tenha de fato a doença? A lenda diz que a maioria dos médicos respondem

sem pestanejar, já que há

de falsos positivos. Essa justificativa está errada. Os eventos de interesse são

“o exame deu positivo” e

“tem probabilite”

a probabilidade de ter a doença é , a probabilidade de um falso positivo é

e a de um falso negativo é

. Queremos determinar

.

Da definição de probabilidade condicional, se e

são eventos com probabilidade positiva então

Usando o teorema da probabilidade total para com a partição

temos

Logo

a chance de ter a doença dado que o teste foi positivo é ligeiramente menor que , ou seja, tal teste é inútil.

— Teorema de Bayes —

A dedução feita acima pode ser facilmente generalizada para provar o seguinte.

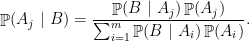

Teorema 12 (Teorema de Bayes) Sejam

eventos que particionam

e

com todos eventos de probabilidade positiva. Para todo

Exemplo 23 Um teste para H1N1 tem 97% de chance de responder certo. Se uma pessoa tem resultado positivo (denotado por “

”), então ela pode estar “

” ou “

”; o que podemos concluir se sabemos que 60% da população que fica doente?

Usando o teorema de Bayes

logo a probabilidade é

.

Exemplo 24 Temos 3 moedas e apenas uma delas, não sabemos qual, é desbalanceada; qualquer uma é a desbalanceada com mesma probabilidade. Essa moeda desbalanceada resulta cara com probabilidade 2/3. Consideremos os eventos

definidos por “a i-ésima moeda é a desbalanceada”; logo

.

Realizamos lançamento de cada uma delas resulta em

,

,

. Consideremos o evento

“o resultado dos lançamentos é

”.

Usando o Teorema de Bayes

lembremos que

, logo “aprendemos mais” sobre as moedas depois do lançamento. Também,

mas

.

Exercicio 35 Um pais extremamente democrático mantém três prisioneiros sem qualquer acusação na prisão de Guantánamo. São eles: Said, Osama e Ayman. O carcereiro diz a eles que um será libertado e os outros serão executados, mas não lhe foi permitido dizer o que acontecerá a cada um. Said avalia que ele tem chance de

de escapar e pensou em perguntar em segredo ao carcereiro qual dos outros prisioneiros seria executado; em seguida avaliou que se o carcereiro respondesse o Osama, por exemplo, então a chance dele escapar passaria a ser

pois seria ou ele e Osama, ou ele e Ayman. Essa avaliação está correta?

— Independência —

Vimos nos exemplos acima, como o exemplo 24, que o conhecimento da ocorrência de um evento afeta a probabilidade de ocorrência de

, a probabilidade

não é, em geral, igual a

. Quando esse não é o caso, dizemos que os eventos são independentes.

Os eventos e

são ditos independentes se

Se os eventos têm probabilidade positiva então decorre da definição acima que a independência de e

equivale a

e

.

Uma coleção de eventos é dita independente se para toda subcoleção finita

vale que

qualquer que seja .

Exemplo 25 Consideremos o espaço amostral com 9 elementos dado pelas 6 permutações das letras

mais as 3 ternas

,

e

, cada uma com probabilidade

. Seja

o evento “a coordenada

é a”. Então

e

para

, portanto os eventos são 2-a-2 independentes, mas não são independentes pois, por exemplo, a ocorrência de

e

implica na ocorrência de

; de fato,

.

Exemplo 26 Consideremos três lançamentos de uma moeda equilibrada e os eventos

“o resultado do primeiro e do segundo coincidem”

“o resultado do primeira e do terceiro coincidem” e

“o resultado do segundo e do terceiro coincidem”.

Os eventos são 2-a-2 independentes,

Analogamente, para

e

, entretanto, esses eventos não são independentes pois

Exemplo 27 Tomemos

com a probabilidade clássica, e consideremos os eventos

,

,

e

. Temos

e

. Portanto

e

são eventos independentes.

Agora,

de modo que

e

não são independentes. Também,

.

Ainda,

de modo que

e

não são independentes .Também,

e

.

Exemplo 28 Um dado de 4 faces tem uma face de cor Azul, uma face de cor Branca, uma face de cor Cinza, e uma face com as três cores, todas com a mesma probabilidade de ocorrência num lançamento. Representamos o resultado de um lançamento pelas letras

. Então

pois cada cor aparece em 2 das 4 faces. Também

, portanto, os eventos são 2-a-2 independentes. Entretanto

portanto os eventos não são independentes.

Exercicio 36 Mostre que se

e

são eventos independentes, então são eventos independentes:

e

;

e

;

e

.

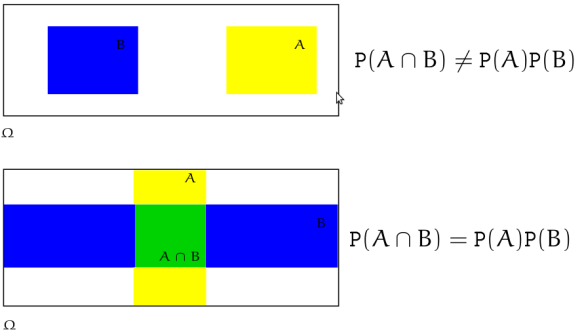

Independência exclusão: Não confunda esses termos.

Na figura de cima os eventos são mutuamente exclusivos mas não independentes. Na figura de baixo os eventos são independentes mas não mutuamente exclusivos.

Problema: Uma urna contém seis bolas, digamos que três são vermelhas e três azuis. Uma dessas bolas, chamemos-a bola , é selecionada ao acaso removida permanentemente da urna sem que a sua cor seja revelada para um observador. Esse observador pode agora retirar bolas sucessivamente, uma de cada vez, de forma aleatória e com reposição um número pré-determinado de vezes. O objetivo dessa experimentação é a formar uma ideia aproximada da proporção de bolas vermelhas e azuis que permaneceram na urna após a retirada da bola

.

Pedro, na condição de observador, retirou uma bola seis vezes, e todos resultados foram bolas vermelhas. Paula retirou uma bola da urna 600 vezes, 303 vezes foram bolas vermelhas e 297 vezes bolas azuis. Claramente, ambos tendem a prever que a bola é, provavelmente, azul. Qual deles, se é que algum, tem a evidência empírica mais forte de sua previsão?

— Mais exemplos —

A seguir, apresentamos mais exemplos a respeito do tema apresentado acima.

Exemplo 30 Suponhamos que o @alunodaufabc está em dúvida entre matricular-se em Física Quântica e Introdução à Probabilidade e à Estatística cujos horários de aula coincidem. Ele estima que a probabilidade de passar com

em FQ é

e a de passar com

em IPE é

. Se ele usar uma moeda para escolher a disciplina, qual é a probabilidade de passar com

em IPE? Se

representa “passar com

” e

representa “cursar IPE”

Exemplo 31 Um investigador de polícia está

convencido da culpa de um determinado suspeito. No decorrer da investigação uma nova evidência na cena do crime prova que o criminoso tinha uma determinada característica, seu pé-direito tem seis dedos. Sabe-se que

da população tem seis dedos no pé direito. Dado que o suspeito tem seis dedos no pé direito, qual é o grau de convencimento do investigador?

Representemos por

o evento “suspeito culpado” e por

o evento “tem seis dedos no pé direito” e temos pelo Teorema de Bayes que

ou seja, o grau de convencimento agora é

.

Exemplo 32 No contexto do exemplo anterior, se

é uma hipótese e

uma evidência então

onde

quantificam, respectivamente, quanto provável é a ocorrência de

com relação a não ocorrência de

, e quão mais provável é a ocorrência de

com relação a não ocorrência após a introdução da evidência

.

Portanto, se a

é culpa e a

é uma característica do criminoso, no exemplo anterior temos

ou seja, após a nova evidência a culpa é 5 vezes mais provável.

Exemplo 33 (Falácia do promotor) Essa falácia geralmente resulta em assumir que a probabilidade prévia de que uma evidência condenaria um membro escolhido aleatoriamente da população é igual à probabilidade de que ela condenaria o réu. Por exemplo, você ganha na loteria, mas é acusado de fraude. No julgamento o promotor afirma que ganhar na loteria sem trapacear é extremamente improvável portanto é igualmente extremamente improvável que você seja inocente. Isso desconsidera que a probabilidade de qualquer outra pessoa ganhe na loteria é igualmente pequena. A confusão típica é, usando a linguagem dos tribunais, que

se

é pequena, então

é pequena.

De fato, essas probabilidade podem ser muito diferentes como mostramos a seguir. No caso de teste de DNA para identificar criminosos, dependendo do número de locus considerado na análise, é possível que a frequência de determinado padrão seja da ordem de 1 em 1 milhão [Technology in Forensic Science]. O erro comum é a confusão resultante de tomar por aproximadamente igual

- a probabilidade que a amostra de DNA de uma outra pessoa (não o criminoso) case com o padrão do DNA descoberto na cena do crime, dado que a pessoa é inocente;

- a probabilidade que a pessoa é inocente dado que seu DNA casa com o padrão do DNA descoberto na cena do crime.

A primeira é a probabilidade atestada por um perito em exame de DNA; quando um teste de DNA atesta que “a probabilidade é de 1 em 100 milhões que o DNA da cena do crime case como DNA do suspeito” isso significa que “a chance do casamento de padrões entre o DNA na cena do crime e do DNA do acusado é de 1 em 100 milhões, se o acusado é inocente e não é parente do criminoso”, pondo de outro modo

é pequena. A segunda probabilidade, descrita acima, é a que interessa ao promotor para poder acusar sem erro o suspeito e uma vez que o resultado positivo é certo

, se o acusado deixou a amostra de DNA na cena do crime então

ou seja, independentemente da chance a priori de culpa, a evidência do DNA torna a probabilidade de culpa 100 milhões de vezes maior que a de inocência, de acordo com a equação (30) acima

Exemplo 34 O seguinte relato foi extraído de uma reportagem da revista TIME de sexta-feira, 8 de janeiro de 1965. “Por volta do meio-dia, em um dia de Junho último, uma mulher idosa foi assaltada em um beco em San Pedro, na Califórnia. Pouco depois, uma testemunha viu uma garota loira com rabo de cavalo saindo do beco e entrando em um carro amarelo conduzido por um negro com barba e bigode. A polícia prendeu e Janet e Malcolm Collins, um casal que que encaixava na descrição física dada pela testemunha e que possuía um Lincoln amarelo.”

Ao apresentar o caso o promotor, que teve acessoria de um professor de matemática local, salientou a baixa probabilidade de haver casais como os Collins em San Pedro, em um carro amarelo pois

- probabilidade de carro amarelo = 1 / 10;

- probabilidade de homem com bigode = 1 / 4;

- probabilidade de mulher com rabo de cavalo = 1 / 10;

- probabilidade mulher tem cabelo loiro = 1 / 3;

- probabilidade de homem negro com barba = 1 / 10;

- probabilidade de casal inter-racial = 1 / 1000;

Multiplicando todos esses valores leva a um valor de 1 em 12 milhões para a probabilidade de haver um casal com as mesmas características de Janet e Malcolm Collins. O casal acabou sendo condenado. Qual é o problema desse argumento?

Veja este link se quiser mais detalhes sobre as considerações legais do processo e o desdobramento. Há vários casos reais de uso incorreto de probabilidade num julgamento, veja os casos Lucia de Berk, Kevin Sweeney, Sally Clark.

Exemplo 35 As seguradoras de automóveis classificam motoristas em propensos a acidentes e não propensos a acidentes; estimam que os propensos são

da população. As estatísticas mostram que os propensos se envolvem em acidente no período de um ano com probabilidade

e os não propensos com probabilidade

. Seja

o evento definido pelos motoristas propensos. Então, a probabilidade de um novo segurado se envolver em acidente em um ano é

se um novo segurado se envolve em acidente nesse prazo, a probabilidade dele ser propenso é

Qual a probabilidade de ocorrer um acidente no 2º ano dado que tenha acidentado no 1º ano de contrato? Definimos a medida de probabilidade, sobre os mesmos evento,

(veja o exercício 34). Dessa forma, pela Lei de Probabilidade Total

onde, por definição,

Exercicio 38 Mostre que

.

Assumiremos que

e

são condicionalmente independentes dado

, ou seja,

que equivale a

.

Portanto,

e temos que

Exemplo 36 (Filtros bayesiano anti-spam) A abordagem Bayesiana para filtrar mensagens (uma das ferramentas do spamassassin, por exemplo) foi ideia de Paul Graham que descreve aqui como eles funcionam. Abaixo daremos uma explicação resumida e formal de como usar o teorema de Bayes na classificação de mensagens que são spam.

O espaço amostral é dado por

de modo que cada coordenada indica se uma mensagem tem (representado por

) ou não tem (representado por

) uma determinada característica e a primeira coordenada de uma

-nupla, especificamente, é

se a mensagem é spam e

caso, contrário.

Assim o evento

dado por

é o evento é spam e

é o evento não é spam.

Denotamos por

,

, o evento “tem a característica

” que corresponde a todos os vetores cuja

-ésima coordenada é

.

Vamos assumir que as características

são independentes condicionalmente

para todo

(pode não ser uma hipótese muito realista. Por exemplo, se a característica

é conter a palavra watch e a característica

é conter a palavra replica então um email que contém replica tem muito mais chance de conter watch; o meu endereço de email recebe várias dessas mensagens que anunciam réplicas de relógios caros e watch só aparece nesses spams; esse pode não ser o caso de um relojoeiro num país de língua inglesa).

(Dica: use o teorema de Bayes com

,

e

.)

Agora, suponha que temos

mensagens,

spams e

não spams. O trabalho inicial é definir características das mensagens que são spams das que não são. Por exemplo, nas minhas mensagens muitos dos spams têm a palavra watch enquanto que muitos dos não spams têm a palavra reunião; a maioria das mensagens têm a palavra a, tantos spams quanto não spams, logo a não deve ser uma característica levada em consideração.

Para a característica

, seja

a quantidade de spams que têm a característica

e seja

a quantidade de não spams que têm a característica

; definimos

e

e pelo teorema de Bayes,

Recebida uma mensagem, filtramo-lá para determinar suas características, digamos

com

, e (31) determina a probabilidade dessa mensagem ser spam.

Exemplo 37 Com que probabilidade uma máquina que está funcionando no instante

continuará funcionando até o instante

supondo que essa probabilidade dependa somente do comprimento do intervalo

, supondo que a probabilidade com que a máquina pare durante um intervalo de comprimento

proporcional a

e supondo que os eventos que consistem da máquina parar durante intervalos disjuntos são independentes?

Se

é a probabilidade procurada. A probabilidade da máquina parar num intervalo de tempo de tamanho

é

, para alguma constante fixa

. A probabilidade com que uma máquina que está funcionando no instante

continuará funcionando até o instante

é

e pela independência assumida

logo

de modo que

que, passando ao limite quando

, resulta em

donde temos

para alguma constante

. De

deduzimos que

.

— Paradoxo de Simpson —

É um paradoxo estatístico descrito por Edward Simpson em 1951 e George Udny Yule em 1903, em que o sucesso em grupos parece ser revertida quando os grupos são combinados. Esse resultado é surpreendente e frequentemente encontrado na prática, especialmente nas ciências sociais e as estatísticas médicas. Há vários casos conhecidos e bem estudados, vamos começar com uma simplificação de um caso conhecido.

200 em 1000 homens e 150 em 1000 mulheres escolhem cursar Economia em uma universidade P. Se o curso for na universidade Q os números são 30 em 100 homens e 1000 em 4000 mulheres. Temos as seguintes proporções por sexo

| Homem | Mulher | |

| P | ||

| Q | ||

| Ambas | ||

Se consideremos os dois cursos em conjunto a proporção de homens é e a de mulheres

, ou seja, em conjunto a proporção de mulheres é maior. Outro exemplo é de um estudo sobre dois tratamentos (H e M, não tem relação com sexo) para pedras no rim, em função do tamanhos das pedras (pequenas ou grandes) em quatros grupos de estudo, a seguinte tabela mostra o sucesso dos tratamentos

| H | M | |

| Pequenas | ||

| Grandes | ||

| Ambos | ||

e o paradoxo é que o tratamento H tem maior taxa de sucesso se consideramos isoladamente as pedras pequenas (0{,}93) ou as pedras grandes (0{,}73), no entanto, no quadro geral o tratamento M tem maior taxa de sucesso (0{,}83).

Em termos gerais, o paradoxo ocorre porque as desigualdades

são compatíveis.

Veja outro exemplo aqui

— Exercícios —

- Mostre que para eventos

,

e

vale

Também vale que, seé evento então

Assuma que todos os eventos envolvidos tenha probabilidade positiva para que as probabilidades condicionais estejam definidas.

- (Regra generalizada do produto) Sejam

eventos tais que

. Então

- Use (35) pare determinar qual é a probabilidade de ocorrer três reis ao se retirar três cartas ao acaso de um baralho.

- O teorema da probabilidade total vale para uma partição enumerável por eventos de

, digamos

com

para todo

?

- No ultimo ano de uma classe com 100 alunos que estão se formando no ensino médio, 42 estudaram matemática, 68 estudaram psicologia, 54 estudaram historia, 22 estudaram matemática e historia, 25 estudaram matemática e psicologia, 7 estudaram historia mas não estudaram matemática nem psicologia, 10 estudaram as três matérias e 8 não estudaram nenhuma. Se um estudante é selecionado ao acaso

(a) qual é a probabilidade que uma pessoa matriculada em psicologia tenha estudado as três matérias;

(b) qual é a probabilidade que uma pessoa não esteja estudando psicologia esteja estudando historia e matemática. - A probabilidade de que um homem casado assista determinado programa de TV é

e a probabilidade que uma mulher casada é

. A probabilidade que um homem assista dado que sua mulher assista é

. Determine a probabilidade de que

(a) um casal assista ao programa; \resp{0,35}

(b) uma esposa assista ao programa, dado que o marido o faça;\resp{0,875}

(c) pelo menos uma pessoa do casal assista ao programa.\resp{0,55} - A probabilidade de que um medico acerte o diagnostico de uma doença é

. Dado que o médico fez um diagnostico incorreto, a probabilidade de que o paciente entre com um processo é

. Qual é a probabilidade de que o médico erre o diagnóstico e seja processado pelo paciente. \resp{0,27}

- Um corretor de imóveis tem oito chaves mestras para abrir diversas casas. Somente uma delas abrirá qualquer uma das casas. Se 40% dessas casas são, normalmente, deixadas destrancadas, qual é a probabilidade de que o corretor entre em uma casa específica se ele selecionou três chaves mestras aleatoriamente antes de sair do escritório?

- Uma cidade tem dois carros de bombeiros operando independentemente. Cada carro tem probabilidade 0,96 de estar disponível em caso de necessidade.

(a) Qual é a probabilidade de que nenhum carro esteja disponível quando necessário? \resp{0,0026}

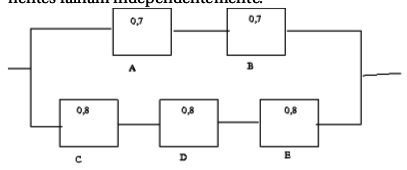

(b) Qual é a probabilidade de que algum carro esteja disponível quando necessário? \resp{0,9984} - Um sistema de circuitos é dado na figura abaixo. Assuma que os componentes falham independentemente.

(a) Qual é a probabilidade que o sistema todo funcione?\resp{0,75112}

(b)Dado que o sistema funciona, qual é a probabilidade de que o componente A não esteja funcionando?\resp{0,2045} - Em certa região do país sabe-seque a probabilidade de selecionar um adulto com mais de 40 anos com câncer é 0,05. Se a probabilidade de um médico diagnosticar corretamente uma pessoa com câncer como portadora da doença é 0,78 e a probabilidade de diagnosticar incorretamente uma pessoa sem câncer como sendo portadora da doença é 0,06, qual é a probabilidade de que a pessoa seja diagnosticada com câncer?

- No exercício acima, qual é a probabilidade de que a pessoa diagnosticada com câncer realmente tenha a doença?

- Suponha que quatro inspetores em uma fabrica e filmes tenham que estampar a data de validade em cada pacote de filme ao final da linha de montagem. João, que estampa 20% dos pacotes, não estampa a data de validade em 1 de cada 20 pacotes; Toni, que estampa 60% dos pacotes, erra uma vez a cada 100 pacotes; Jeff, que estampa 15% dos pacotes, erra uma vez a cada 90 pacotes e Paty que estampa 5% dos pacotes, erra uma vez a cada 200 pacotes. Se um cliente reclame que sua embalagem de filme não contém a data de validade, qual é a probabilidade de que ela tenha sido inspecionada por João?\resp{0,1124}

- Considere os seguintes eventos

Assuma

,

,

,

,

,

e

. Determine

-

;\resp{0,045}

-

;\resp{0,564}

-

;\resp{0,63}

- determine a probabilidade de o rio ser poluído, dado que a pesca é permitida e a amostra testada não detectou poluição.\resp{0,1064}

-

- Mostre que se

é uma medida de probabilidade e

um evento com probabilidade positiva, então

dada por

é uma medida de de probabilidade para os mesmos eventos.

- Mostre que se

e

são eventos independentes, então

e

são eventos independentes;

e

são eventos independentes;

e

são eventos independentes.

- Mostre que para eventos

,

,

e

são eventos então

Assuma que todos os eventos envolvidos tenha probabilidade positiva para que as probabilidades condicionais estejam definidas.

- Seja

para

primo e

, para todo

. Prove que se

e

são independentes então pelo menos um desses eventos deve ser

ou

.